Um estudo qualitativo realizado pelo Centro Regional de Estudos para o Desenvolvimento da Sociedade da Informação (Cetic.br), do Núcleo de Informação e Coordenação do Ponto BR (NIC.br), revelou um cenário de uso indiscriminado da inteligência artificial nas escolas brasileiras. A pesquisa "Inteligência Artificial na Educação: usos, oportunidades e riscos no cenário brasileiro" ouviu alunos e professores do ensino médio de escolas públicas e privadas das capitais de São Paulo e Pernambuco, apontando para uma adoção massiva e sem mediação dessa tecnologia.

Dados anteriores da pesquisa TIC Educação, divulgada em setembro pelo Cetic.br, já mostravam que 70% dos alunos do ensino médio - aproximadamente 5,2 milhões de estudantes - e 58% dos professores utilizam ferramentas de IA generativa em atividades escolares. "Um uso quase selvagem, porque eles usam para tudo, desde pesquisar uma palavra, até entender uma dor que estão sentindo, receita, lembrete, para várias atividades escolares, anotações, para fazer resumo, para realizar tarefas inteiras, até para suporte emocional", descreveu à Agência Brasil a coordenadora da pesquisa, Graziela Castello.

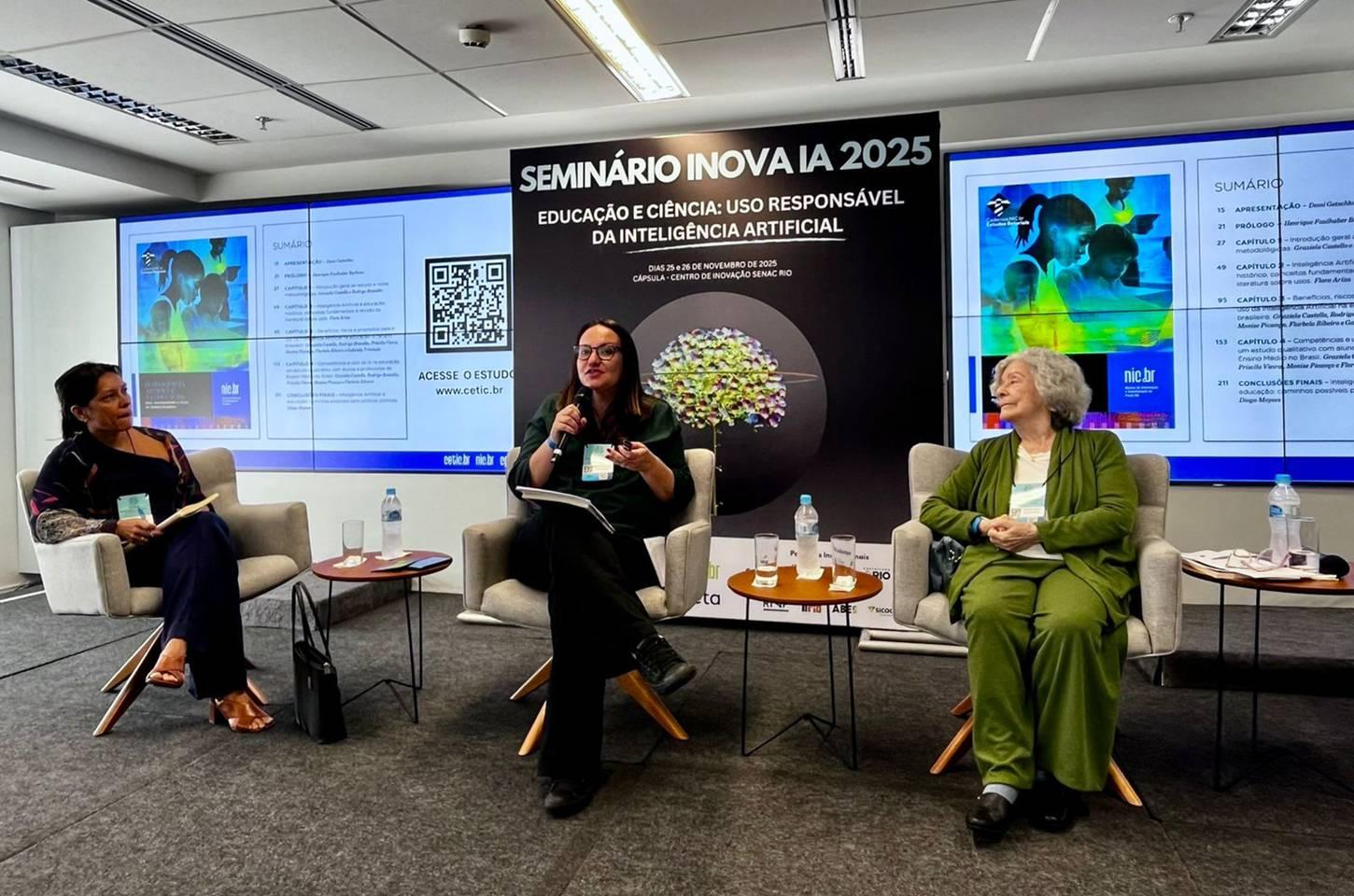

O trabalho de campo foi realizado entre junho e agosto de 2025, com resultados divulgados nesta terça-feira (25) durante o seminário INOVA IA 2025, no Rio de Janeiro. Segundo Graziela, o que há de convergente entre alunos e professores é que ambos estão usando a IA sem nenhuma mediação, orientação, supervisão ou regramento dado pelas escolas ou outras instituições. "E eles querem informação, querem saber como usar de maneira ética, segura, sem riscos", afirmou a coordenadora.

De acordo com o estudo, a solução passa pela necessidade de acelerar o processo em termos de regimento, protocolos e políticas que estabeleçam, minimamente, uma baliza para uma visão mais segura, acompanhada de ações com escala que capacitem professores e alunos. "Daí a necessidade de investir em formação, mas também em regulação, como uma maneira de dar normas e orientações para que as pessoas, nesse primeiro momento, saibam como fazer e o que não fazer", indicou Graziela.

Riscos e preocupações

Graziela Castello explicou que, ao contrário do que aconteceu com a internet, que já entrou na vida das pessoas de uma maneira muito acelerada, "a IA entrou chutando a porta. Entrou e eles (alunos e professores) usam, e usam mesmo, mas também reconhecem os riscos desse uso".

O estudo revela que, apesar de utilizarem muito a IA, os alunos têm medo de desaprender, de "emburrecer" com o uso dessas tecnologias. Têm medo de ficarem dependentes, de não conseguirem criar ou de exercer a criatividade, de perderem a identidade. "(Medo) de que, agora, o processo fique tão pasteurizado que eles percam a nuance daquilo que são", destacou a pesquisadora.

Do mesmo modo, os professores também fazem uso da IA generativa, principalmente como suporte para atividades cotidianas. Eles reconhecem que tem um potencial forte para redução de tarefas repetitivas, como suporte para conseguir ter outros recursos, atividades mais alternativas, inclusive para gradações de tarefas. "Tem um potencial de tentar customizar atividades para os perfis dos alunos", observou Graziela.

No entanto, os educadores sabem que os alunos estão usando a IA, mas não sabem como mediar esse uso e, portanto, ficam sem ação. Os professores se mostraram muito preocupados porque sabem que os alunos fazem uso da IA de maneira autônoma, não conseguiram relatar benefícios neste momento e se preocupam muito com o uso que estão vendo.

Desigualdades digitais

A pesquisa apurou diferenças também entre alunos de escolas públicas e privadas no uso da IA. "O que existe de diferença mais fundamental são as desigualdades de acesso à infraestrutura, que já são anteriores à vinda da IA", explicou a coordenadora. Alunos de escolas privadas têm acesso a outros equipamentos, como computador em casa, o que torna o uso da IA mais proveitoso. Já se o aluno está restrito ao celular, tem muito mais dificuldade de operar essas ferramentas.

Com o conteúdo sendo pago ou gratuito, isso já representa mais uma camada adicional de desigualdade. Com o serviço pago, há possibilidade de se fazer usos mais oportunos. "Fundamentalmente, você tem ainda a reprodução de desigualdades em infraestrutura digital que vão ampliar, se não forem contornadas, ainda mais essa desigualdade de oportunidades entre escolas públicas e privadas", alertou Graziela.

Caminhos para uma adoção segura

A adoção segura dessa tecnologia e a construção de políticas públicas para orientar o uso da IA têm de ter como precedente o letramento, ou seja, orientação para alunos e professores sobre como funciona essas ferramentas. "Acho que a primeira fase é dar letramento, conhecimento para a população como um todo sobre o que significa essa tecnologia, como ela é construída, quem detém esses dados hoje em dia, quem são os donos das informações", defendeu a pesquisadora.

Outra preocupação importante é saber se essas ferramentas de IA são adaptáveis ao contexto brasileiro. "Será que ao trabalhar com os estudantes não estamos dando dados do contexto de outros países? Será que a gente tem tecnologia própria que garanta que estamos sendo fidedignos aos problemas internos do Brasil?", questionou Graziela.

"Tem uma série de enfrentamentos que têm de ser feitos simultaneamente. A questão é que a coisa (IA) entrou com uma velocidade e a gente vai ter que trocar a roda do carro com ele andando", comparou a coordenadora, destacando a urgência do tema.

Outras questões de destaque visam a criação de um pensamento crítico, como os estudantes podem checar as informações que recebem. Eles entendem que há erros factuais, expressões preconceituosas e negativas, que não conseguem gerenciar. Esse é um outro ponto de atenção: saber como desenvolver essa habilidade técnica, as possibilidades dessa ferramenta sem redução da capacidade criativa dos alunos.

Para Graziela Castello, essas são notícias importantes para os gestores públicos sobre a urgência em estabelecer políticas e ações que ajudem a orientar esse uso de um jeito proveitoso e oportuno. "E tentando minimizar os riscos, que não são poucos", finalizou a coordenadora, enfatizando a necessidade de um enfrentamento que permita avançar na discussão de construção de um pensamento crítico, a fim de que não se reproduzam possíveis erros e vieses que vêm dessas tecnologias.